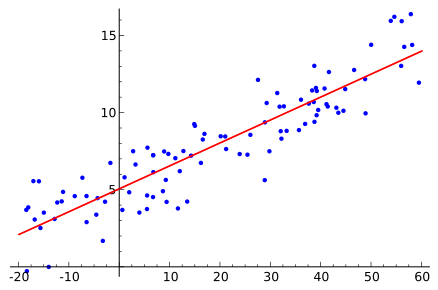

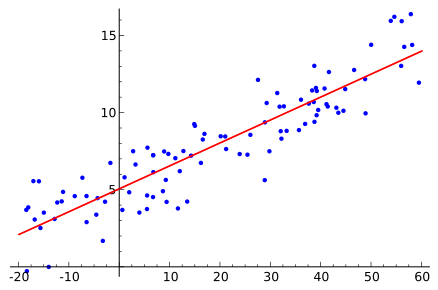

回归任务

f(x)=wx+wx+…+b

f = wx

误差函数 损失函数

loss = (f-y)2=(wx-y)2

误差平均值

穷举法

去猜 穷举法参数多 不现实 用最小二乘法

最小二乘法

损失函数是二次方程 有最小值

极小值 倒数为0

求导 函数的微分/自变量的微分

w = y/x

向量最小二乘法计算

但是矩阵的w有可能解不出来 所以要梯度下降法

梯度下降法

w=w-a梯度 a是步伐

梯度 损失求导

学习率 求梯度 梯度更新

回归任务

f(x)=wx+wx+…+b

f = wx

误差函数 损失函数

loss = (f-y)2=(wx-y)2

误差平均值

去猜 穷举法参数多 不现实 用最小二乘法

损失函数是二次方程 有最小值

极小值 倒数为0

求导 函数的微分/自变量的微分

w = y/x

向量最小二乘法计算

但是矩阵的w有可能解不出来 所以要梯度下降法

w=w-a梯度 a是步伐

梯度 损失求导

学习率 求梯度 梯度更新

扫码打开当前页

之前